هل تريد مؤسستك تجميع البيانات وتحليلها لمعرفة الاتجاهات ، ولكن بطريقة تحمي الخصوصية؟ أو ربما أنك تستخدم بالفعل أدوات خصوصية تفاضلية ، ولكنك تريد توسيع (أو مشاركة) معرفتك؟ في كلتا الحالتين ، فإن سلسلة المدونة هذه لك.

لماذا نقوم بهذه السلسلة؟ في العام الماضي ، أطلق المعهد القومي للمعايير والتقنية (NIST) مساحة تعاون هندسة الخصوصية لتجميع الأدوات والحلول والعمليات مفتوحة المصدر التي تدعم هندسة الخصوصية وإدارة المخاطر. بصفتنا مشرفين على Collaboration Space ، فقد ساعدنا NIST على جمع أدوات الخصوصية التفاضلية ضمن مجال موضوع إزالة الهوية. نشر المعهد القومي للمعايير والتقنية أيضًا إطار الخصوصية: أداة لتحسين الخصوصية من خلال إدارة مخاطر المؤسسة وخريطة طريق مصاحبة اعترفت بعدد من مجالات التحدي للخصوصية ، بما في ذلك موضوع إزالة الهوية. نود الآن الاستفادة من Collaboration Space للمساعدة في سد فجوة خريطة الطريق بشأن إزالة الهوية. هدفنا النهائي هو دعم NIST في تحويل هذه السلسلة إلى إرشادات أكثر عمقًا حول الخصوصية التفاضلية.

ستبدأ كل مشاركة بأساسيات مفاهيمية وحالات استخدام عملية ، تهدف إلى مساعدة المهنيين مثل مالكي العمليات التجارية أو موظفي برنامج الخصوصية على التعلم بما يكفي ليكون خطرًا (مجرد مزاح). بعد تغطية الأساسيات ، سنلقي نظرة على الأدوات المتاحة وأساليبها التقنية لمهندسي الخصوصية أو متخصصي تكنولوجيا المعلومات المهتمين بتفاصيل التنفيذ. لإطلاع الجميع على السرعة ، ستوفر هذه المشاركة الأولى خلفية عن الخصوصية التفاضلية وتصف بعض المفاهيم الأساسية التي سنستخدمها في بقية السلسلة.

المحتويات

التحدي

كيف يمكننا استخدام البيانات للتعرف على السكان ، دون التعرف على أفراد معينين ضمن السكان؟ فكر في هذين السؤالين:

- “كم عدد الأشخاص الذين يعيشون في ولاية فيرمونت؟”

- “كم شخصًا اسمه جو نير يعيش في فيرمونت؟”

الأول يكشف عن خاصية لجميع السكان ، بينما يكشف الثاني عن معلومات عن شخص واحد. نحن بحاجة إلى أن نكون قادرين على التعرف على اتجاهات السكان مع منع القدرة على تعلم أي شيء جديد عن فرد معين. هذا هو الهدف من العديد من التحليلات الإحصائية للبيانات ، مثل الإحصاءات التي ينشرها مكتب الإحصاء الأمريكي ، والتعلم الآلي على نطاق أوسع. في كل من هذه الإعدادات ، تهدف النماذج إلى الكشف عن الاتجاهات في المجموعات السكانية ، لا تعكس معلومات حول أي فرد.

ولكن كيف يمكننا الإجابة على السؤال الأول “كم عدد الأشخاص الذين يعيشون في فيرمونت؟” – وهو ما سنشير إليه على أنه استعلام – مع منع الإجابة عن السؤال الثاني “كم عدد الأشخاص الذين يسميون جو يعيشون في فيرمونت؟” يسمى الحل الأكثر استخدامًا إزالة الهوية (أو إخفاء الهوية)، الذي يزيل معلومات التعريف من مجموعة البيانات. (سنفترض بشكل عام أن مجموعة البيانات تحتوي على معلومات تم جمعها من العديد من الأفراد.) خيار آخر هو السماح فقط بالاستعلامات المجمعة ، مثل المتوسط فوق البيانات. لسوء الحظ ، نحن نفهم الآن أن كلا النهجين لا يوفر حماية قوية للخصوصية. تخضع مجموعات البيانات غير المحددة لهجمات ربط قاعدة البيانات. يحمي التجميع الخصوصية فقط إذا كانت المجموعات التي يتم تجميعها كبيرة بما فيه الكفاية ، وحتى ذلك الحين ، لا تزال هجمات الخصوصية ممكنة [1, 2, 3, 4].

الخصوصية التفاضلية

الخصوصية التفاضلية [5, 6] هو تعريف رياضي لمعنى الخصوصية. إنها ليست عملية محددة مثل إزالة الهوية ، ولكنها خاصية يمكن أن تحتوي عليها العملية. على سبيل المثال ، من الممكن إثبات أن خوارزمية معينة “ترضي” الخصوصية التفاضلية.

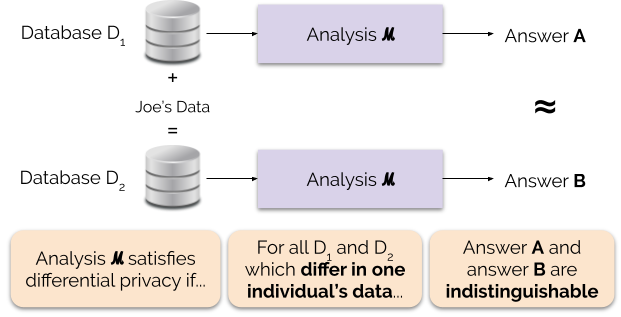

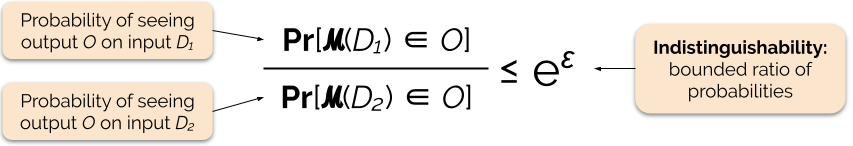

بشكل غير رسمي ، تضمن الخصوصية التفاضلية ما يلي لكل فرد يساهم ببيانات للتحليل: سيكون ناتج التحليل الخاص التفاضلي هو نفسه تقريبًا ، سواء كنت تساهم ببياناتك أم لا. غالبًا ما يسمى التحليل الخاص التفاضلي آلية، ونشير إليه ℳ.

يوضح الشكل 1 هذا المبدأ. يتم حساب الإجابة “A” بدون بيانات Joe ، بينما يتم احتساب الإجابة “B” مع بيانات Joe. تقول الخصوصية التفاضلية أنه لا يمكن التمييز بين الجوابين. هذا يعني أن كل من يرى الناتج لن يكون قادرًا على معرفة ما إذا كانت بيانات جو قد تم استخدامها أم لا ، أو ما تحتويه بيانات جو.

نحن نتحكم في قوة ضمان الخصوصية عن طريق ضبط معلمة الخصوصية، يسمى أيضا أ فقدان الخصوصية أو ميزانية الخصوصية. كلما كانت قيمة المعلمة lower أقل ، كلما كان من غير الممكن تمييز النتائج ، وبالتالي زادت حماية بيانات كل فرد.

يمكننا غالبًا الإجابة على استعلام بخصوصية تفاضلية عن طريق إضافة بعض الضوضاء العشوائية إلى إجابة الاستعلام. يكمن التحدي في تحديد مكان إضافة الضوضاء ومقدار إضافتها. واحدة من أكثر الآليات المستخدمة شيوعًا لإضافة الضوضاء هي آلية لابلاس [5, 7].

تتطلب الاستعلامات ذات الحساسية العالية إضافة المزيد من الضوضاء من أجل تلبية كمية `epsilon` معينة من الخصوصية التفاضلية ، وهذا الضجيج الإضافي لديه القدرة على جعل النتائج أقل فائدة. سنصف الحساسية وهذه المقايضة بين الخصوصية والفائدة بمزيد من التفصيل في مشاركات المدونة المستقبلية.

فوائد الخصوصية التفاضلية

للخصوصية التفاضلية العديد من المزايا المهمة مقارنة بتقنيات الخصوصية السابقة:

- يفترض جميع المعلومات هي معلومات التعريف، القضاء على المهمة الصعبة (والمستحيلة في بعض الأحيان) للمحاسبة لجميع عناصر تحديد البيانات.

- أنه مقاومة هجمات الخصوصية بناء على المعلومات المساعدة، لذلك يمكن أن يمنع بشكل فعال هجمات الربط التي يمكن أن تكون على البيانات غير المحددة.

- أنه التركيبية – يمكننا تحديد فقدان الخصوصية لإجراء تحليلين خاصين مختلفين على نفس البيانات عن طريق إضافة خسائر الخصوصية الفردية للتحليلين. تعني التركيبة أنه يمكننا تقديم ضمانات ذات مغزى حول الخصوصية حتى عند إصدار نتائج تحليل متعددة من نفس البيانات. تقنيات مثل إزالة الهوية ليست تركيبية ، ويمكن أن تؤدي الإصدارات المتعددة بموجب هذه التقنيات إلى فقدان كارثي للخصوصية.

هذه المزايا هي الأسباب الرئيسية التي قد تجعل الممارس يختار الخصوصية التفاضلية على بعض تقنيات خصوصية البيانات الأخرى. العيب الحالي للخصوصية التفاضلية هو أنها جديدة إلى حد ما ، ولا يمكن الوصول بسهولة إلى الأدوات والمعايير وأفضل الممارسات القوية خارج مجتمعات البحث الأكاديمي. ومع ذلك ، نتوقع إمكانية التغلب على هذا القيد في المستقبل القريب بسبب زيادة الطلب على حلول قوية وسهلة الاستخدام لخصوصية البيانات.

التالي

ابق على اطلاع: ستبني مشاركتنا التالية على هذا المنشور من خلال استكشاف مشكلات الأمان التي ينطوي عليها نشر الأنظمة للخصوصية التفاضلية ، بما في ذلك الفرق بين وسط و محلي نماذج الخصوصية التفاضلية.

قبل أن نذهب – نريد أن تساهم هذه السلسلة وإرشادات NIST اللاحقة في جعل الخصوصية التفاضلية أكثر سهولة. يمكنك مساعدة. سواء كانت لديك أسئلة حول هذه المنشورات أو يمكنك مشاركة معرفتك ، نأمل أن تتفاعل معنا حتى نتمكن من تعزيز هذا الانضباط معًا.

المراجع

[1] Garfinkel ، Simson ، John M. Abowd ، and Christian Martindale. “فهم هجمات إعادة بناء قاعدة البيانات على البيانات العامة.” اتصالات ACM 62.3 (2019): 46-53.

[2] جادوتي وأندريا وآخرون. “عندما تكون الإشارة في الضجيج: استغلال الضوضاء اللاصقة لـ diffix.” الندوة الأمنية الثامنة والعشرون USENIX (USENIX Security 19). 2019.

[3] دينور وإريت وكوبي نسيم. “الكشف عن المعلومات مع الحفاظ على الخصوصية”. وقائع الندوة الثانية والعشرين ACM SIGMOD-SIGACT-SIGART حول مبادئ أنظمة قواعد البيانات. 2003.

[4] سويني ، لاتانيا. “الخصائص الديمغرافية البسيطة غالبًا ما تحدد الأشخاص بشكل فريد.” الصحة (سان فرانسيسكو) 671 (2000): 1-34.

[5] Dwork ، Cynthia ، وآخرون. “معايرة الضوضاء للحساسية في تحليل البيانات الخاصة.” مؤتمر نظرية التشفير. سبرينغر ، برلين ، هايدلبرغ ، 2006.

[6] وود ، ألكسندرا ، ميخا ألتمان ، آرون بمبينيك ، مارك بون ، ماركو جابوري ، جيمس هوناكير ، كوبي نسيم ، ديفيد آر أوبراين ، توماس ستينكي ، وسليل فادهان. “الخصوصية التفاضلية: تمهيد لجمهور غير تقني.” فاند. J. Ent. & تقنية. 21 (2018): 209.

[7] دورك وسينثيا وآرون روث. “الأسس الخوارزمية للخصوصية التفاضلية.” أسس واتجاهات في علوم الكمبيوتر النظرية 9 ، لا. 3-4 (2014): 211-407.